Un réseau à architecture évolutive, ART

Carpenter et Grossberg développent, en 1987, l’ART (Adaptive Resonance Theory /Théorie de Résonance Adaptative).

C’est un modèle de réseau de neurones à architecture évolutive. Dans la plupart des réseaux de neurones, il existe deux étapes :

Exemple avec le réseau ART1 :

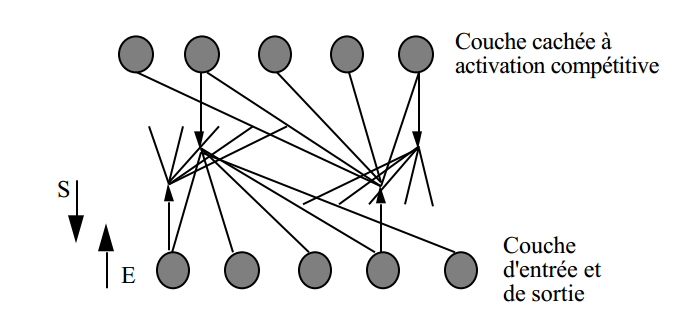

Le réseau ART1 est formé d'une couche d'entrée qui est aussi la couche de sortie et d'une couche cachée. Le terme de couche cachée est emprunté au réseau multicouche, il souligne le fait que cette couche n'est pas directement observable par l'utilisateur à la différence de l'entrée ou de la sortie. Il n'y a pas de connexion entre les neurones d'entrées. Par contre, la couche cachée est une couche d'activation compétitive, tous les neurones sont reliés les uns aux autres par des connexions inhibitrices de poids fixes. Chaque neurone de la couche d'entrée est relié à tous les neurones de la couche cachée et, réciproquement, chaque neurone de la couche cachée est relié à tous les neurones de la couche de sortie. A chaque connexion est associé un poids.

C’est un modèle de réseau de neurones à architecture évolutive. Dans la plupart des réseaux de neurones, il existe deux étapes :

- La première est la phase d'apprentissage : les poids des connexions sont modifiés selon une règle d'apprentissage.

- La deuxième est la phase d'exécution où les poids ne sont plus modifiés.

Exemple avec le réseau ART1 :

Le réseau ART1 est formé d'une couche d'entrée qui est aussi la couche de sortie et d'une couche cachée. Le terme de couche cachée est emprunté au réseau multicouche, il souligne le fait que cette couche n'est pas directement observable par l'utilisateur à la différence de l'entrée ou de la sortie. Il n'y a pas de connexion entre les neurones d'entrées. Par contre, la couche cachée est une couche d'activation compétitive, tous les neurones sont reliés les uns aux autres par des connexions inhibitrices de poids fixes. Chaque neurone de la couche d'entrée est relié à tous les neurones de la couche cachée et, réciproquement, chaque neurone de la couche cachée est relié à tous les neurones de la couche de sortie. A chaque connexion est associé un poids.

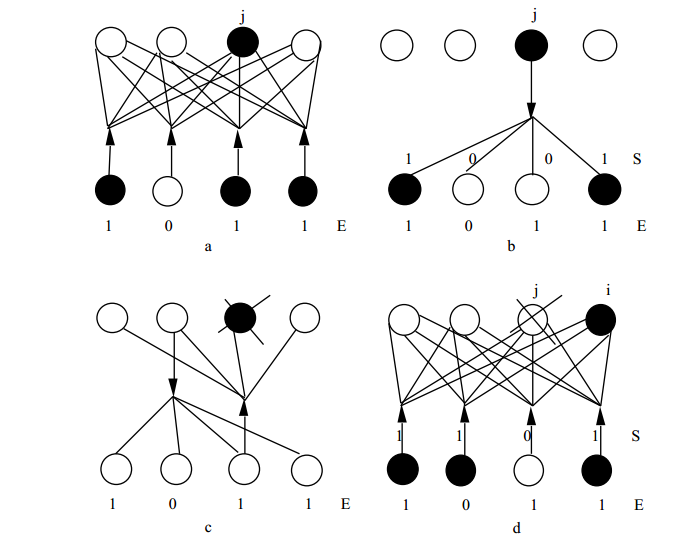

Les schéma ci-dessous montre un vecteur d'entrée E soumis au réseau. A cette entrée correspond, après compétition entre les neurones de la couche cachée, un unique neurone j gagnant.

Ce gagnant est considéré par le réseau comme le plus représentatif du vecteur d'entrée E. Le neurone j génère en retour sur la couche de sortie un vecteur S binaire (seuillage). S est ensuite comparé au vecteur d'entrée E. Si la différence est inférieure à un seuil fixé pour le réseau, le neurone gagnant est considéré comme représentant de la classe du vecteur d'entrée. Dans ce cas, la modification des poids des connexions du neurone gagnant a pour effet de consolider ses liens d'activation avec l'entrée E ; en fait l'adéquation entre ce vecteur d'entrée et cette classe est améliorée. Dans le cas contraire, le processus reprend avec les neurones de la couche cachée moins le neurone gagnant de l'étape précédente. Si tous les neurones cachés sont passés en revue sans qu'aucun ne corresponde à E, un nouveau neurone caché est ajouté, qui est initialisé comme représentant de la classe du vecteur d'entrée E.

Ce gagnant est considéré par le réseau comme le plus représentatif du vecteur d'entrée E. Le neurone j génère en retour sur la couche de sortie un vecteur S binaire (seuillage). S est ensuite comparé au vecteur d'entrée E. Si la différence est inférieure à un seuil fixé pour le réseau, le neurone gagnant est considéré comme représentant de la classe du vecteur d'entrée. Dans ce cas, la modification des poids des connexions du neurone gagnant a pour effet de consolider ses liens d'activation avec l'entrée E ; en fait l'adéquation entre ce vecteur d'entrée et cette classe est améliorée. Dans le cas contraire, le processus reprend avec les neurones de la couche cachée moins le neurone gagnant de l'étape précédente. Si tous les neurones cachés sont passés en revue sans qu'aucun ne corresponde à E, un nouveau neurone caché est ajouté, qui est initialisé comme représentant de la classe du vecteur d'entrée E.

Fonctionnement du réseau ART1.

a) Présentation du vecteur d'entrée E, un neurone gagnant j est sélectionné.61

b) Tentative d'unification entre S (retour du neurone j) et E.

c) Echec : suppression du neurone gagnant, présentation de E.

d) Unification : le neurone i est un représentant de la classe du vecteur d'entrée E.

a) Présentation du vecteur d'entrée E, un neurone gagnant j est sélectionné.61

b) Tentative d'unification entre S (retour du neurone j) et E.

c) Echec : suppression du neurone gagnant, présentation de E.

d) Unification : le neurone i est un représentant de la classe du vecteur d'entrée E.