Théorie

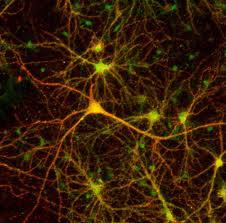

Les réseaux de neurones artificiels ou neuromimétiques sont en fait une imitation, un modèle de calcul de conception très schématiquement inspirée du fonctionnement des neurones biologiques donc du fonctionnement du cerveau et du système nerveux.

Ils sont basés sur un modèle simplifié de neurone qui permet certaines fonctions du cerveau :

-ils sont aussi massivement parallèles (comporter un système qui emploi le parallélisme à grande échelle, connectant de très nombreuses unités logiques de calcul).

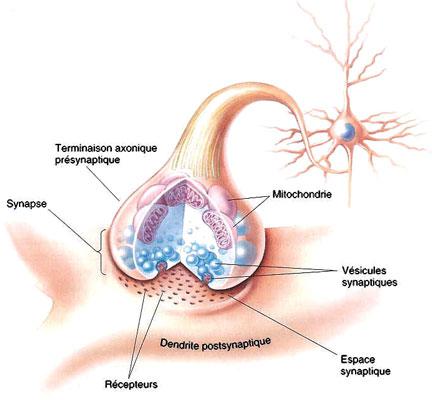

Cependant le neurone formel (représentation mathématique et informatique d'un neurone biologique) ne possède pas toutes les capacités des neurones biologiques, comme par exemple le partage de synapses (une zone de contact fonctionnelle qui s'établit entre deux neurones, ou entre un neurone et une autre cellule), l'activation membranaire ou la structuration prénatale des neurones (la structuration des neurones à l’enfance lorsque celles-ci établissent des liens durables entre elles), par conséquent les réseaux de neurones actuels sont loin d'avoir les possibilités du cerveau.

- la mémorisation associative (Technique permettant de mémoriser et pour rappeler en associant par exemple : des sonorités aux chiffres, des caractéristiques aux visages, des images mentales aux mots ...).

- l'apprentissage par l'exemple

- le travail en parallèle (et autres ...)

- d’apprendre

- de mémoriser l’information dans les connexions entre les neurones

-ils sont aussi massivement parallèles (comporter un système qui emploi le parallélisme à grande échelle, connectant de très nombreuses unités logiques de calcul).

Cependant le neurone formel (représentation mathématique et informatique d'un neurone biologique) ne possède pas toutes les capacités des neurones biologiques, comme par exemple le partage de synapses (une zone de contact fonctionnelle qui s'établit entre deux neurones, ou entre un neurone et une autre cellule), l'activation membranaire ou la structuration prénatale des neurones (la structuration des neurones à l’enfance lorsque celles-ci établissent des liens durables entre elles), par conséquent les réseaux de neurones actuels sont loin d'avoir les possibilités du cerveau.

Histoire :

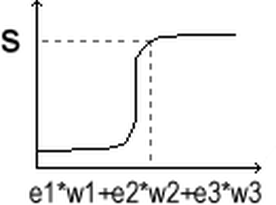

En 1943, apparait le premier neurone formel de Mc Culloch et Pitts imitant le neurone biologique, capable de mémoriser des fonctions booléennes simples (autre nom des fonctions logiques, appellation la plus utilisée lorsque l’on parle des propriétés algébriques de ces fonctions) afin d’adapter le fonctionnement de notre cerveau à un ordinateur.

En 1943, apparait le premier neurone formel de Mc Culloch et Pitts imitant le neurone biologique, capable de mémoriser des fonctions booléennes simples (autre nom des fonctions logiques, appellation la plus utilisée lorsque l’on parle des propriétés algébriques de ces fonctions) afin d’adapter le fonctionnement de notre cerveau à un ordinateur.

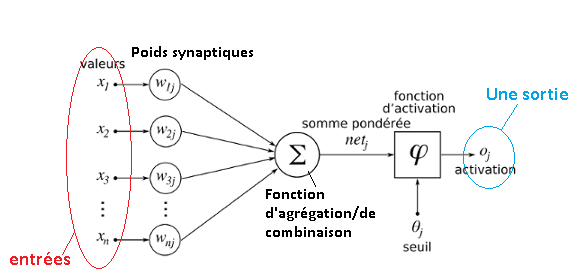

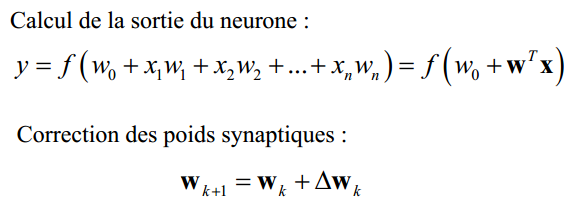

Dans leur modèle, les entrées comme les sorties sont binaires (égale à 0 ou 1). Le neurone réalise une somme pondérée des entrées. La fonction de Heaviside (du nom de Oliver Heaviside, c’est une fonction H discontinue prenant la valeur 0 pour tous les réels strictement négatifs et la valeur 1 partout ailleurs) est ensuite utilisée afin de vérifier si cette pondérée est ou non au-dessus d’un certain seuil.

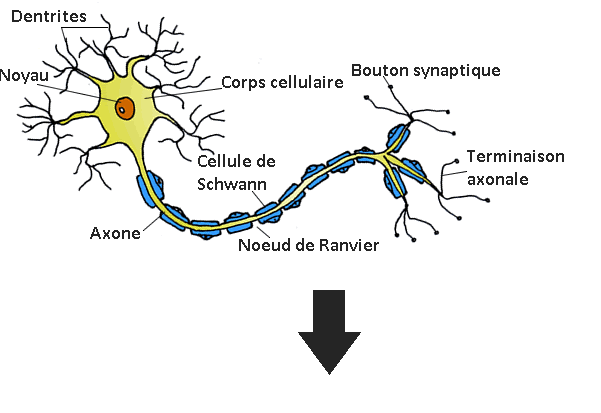

Neurone biologique :

Neurone biologique :

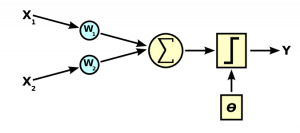

Neurone formel :

En 1949, Hebb Donald met en évidence l’importance du couplage synaptique dans l’apprentissage ou dégénérescence des liaisons inter-neuronales lors de l’interaction du cerveau avec le milieu extérieur.

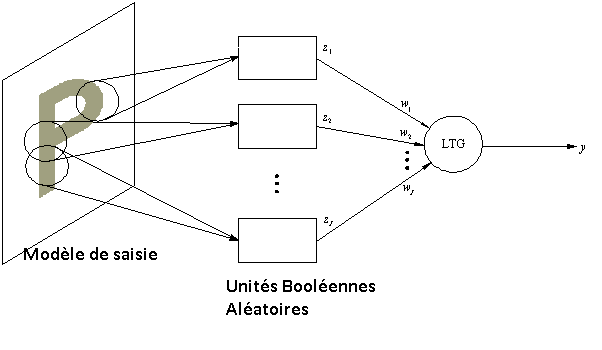

En 1957, Frank Rosenblatt crée le premier réseau de neurones à partir de McCulloch et Pitts : le Perceptron. Il est capable d’apprentissage s’inspirant du modèle visuel. Il s’agit d’un réseau très simple, où les neurones sont disposés en une seule couche (en dehors des entrées et des sorties), les connexions se font uniquement vers l’avant et dont la topographie (Technique de représentation graphique d’un terrain et de ses caractéristiques) ne peut pas évoluer. En revanche, les poids synaptiques peuvent être modifiés afin de parvenir au résultat souhaité, permettant de faire varier l’efficacité de la transmission des signaux d’un neurone à l’autre, ces poids équivalent à la plasticité synaptique des réseaux biologiques. Ce réseau est capable de réaliser les mêmes opérations qu’un classifieur linéaire (famille d'algorithmes de classement statistique, son rôle est de classer dans des groupes (des classes) les échantillons (statistiques) qui ont des propriétés similaires, mesurées sur des observations).

En 1969, les limites de la performance du Perceptron sont montrées par deux mathématiciens Minsky et Papert.

En 1982, Hopfield démontre que les réseaux de neurones artificiels sont capable de résoudre des problèmes d’optimisation et Kohonen, qu’ils sont capables de résoudre des taches de classification et de reconnaissance.

Comment ça marche ?

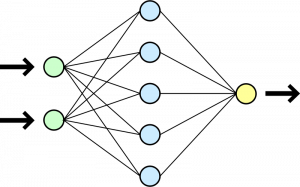

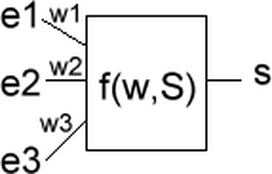

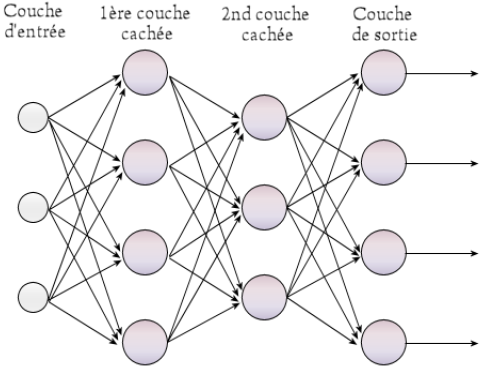

Ce sont des réseaux fortement connectés de processeurs élémentaires fonctionnant en parallèle. Chaque processeur élémentaire (neurone artificiel) calcule une sortie unique sur la base des informations qu’il reçoit.

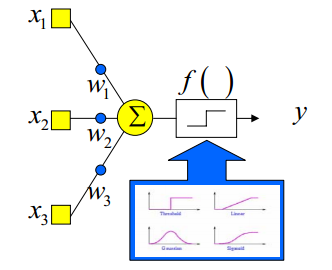

Ces neurones sont modélisés en générale ainsi (de manière logicielle, ou matérielle par des automates) :

En 1982, Hopfield démontre que les réseaux de neurones artificiels sont capable de résoudre des problèmes d’optimisation et Kohonen, qu’ils sont capables de résoudre des taches de classification et de reconnaissance.

Comment ça marche ?

Ce sont des réseaux fortement connectés de processeurs élémentaires fonctionnant en parallèle. Chaque processeur élémentaire (neurone artificiel) calcule une sortie unique sur la base des informations qu’il reçoit.

Ces neurones sont modélisés en générale ainsi (de manière logicielle, ou matérielle par des automates) :

Représenté graphiquement :

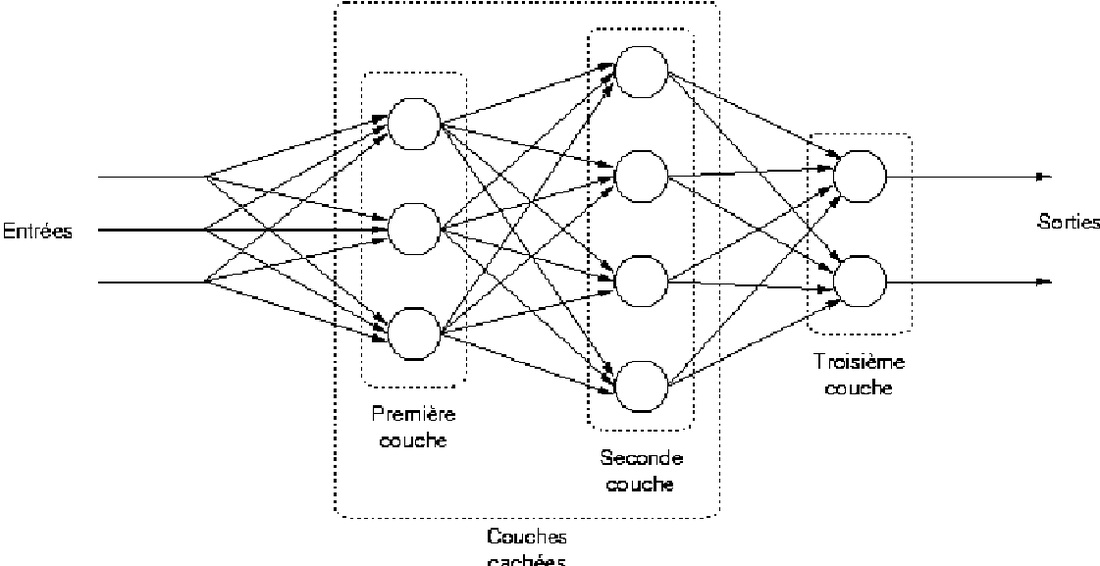

Les réseaux « feed forward » :

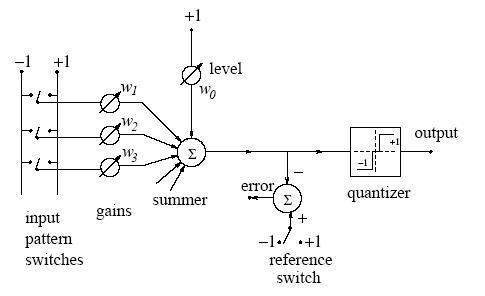

Exemple de calcul avec un neurone formel à 3 entrées :

Il existe deux types de neurone formel :

-Le Perceptron de Rosenblatt en 1958 :

-Le Perceptron de Rosenblatt en 1958 :

-L’Adaline (ADApitve LINear Element) de B. Widrow et T. Hoff en 1960 :

Parallel Distributed Processing :

–Calculs élémentaires et parallèles

–Données/informations distribuées dans le réseau

–Calculs élémentaires et parallèles

–Données/informations distribuées dans le réseau